13-Directional Stimulus Prompting

March 27, 2026About 1 minPrompting TechniquesDirectional Stimulus Prompting

| 版本 | 内容 | 时间 |

|---|---|---|

| V1 | 新建 | 2026年03月27日11:15:10 |

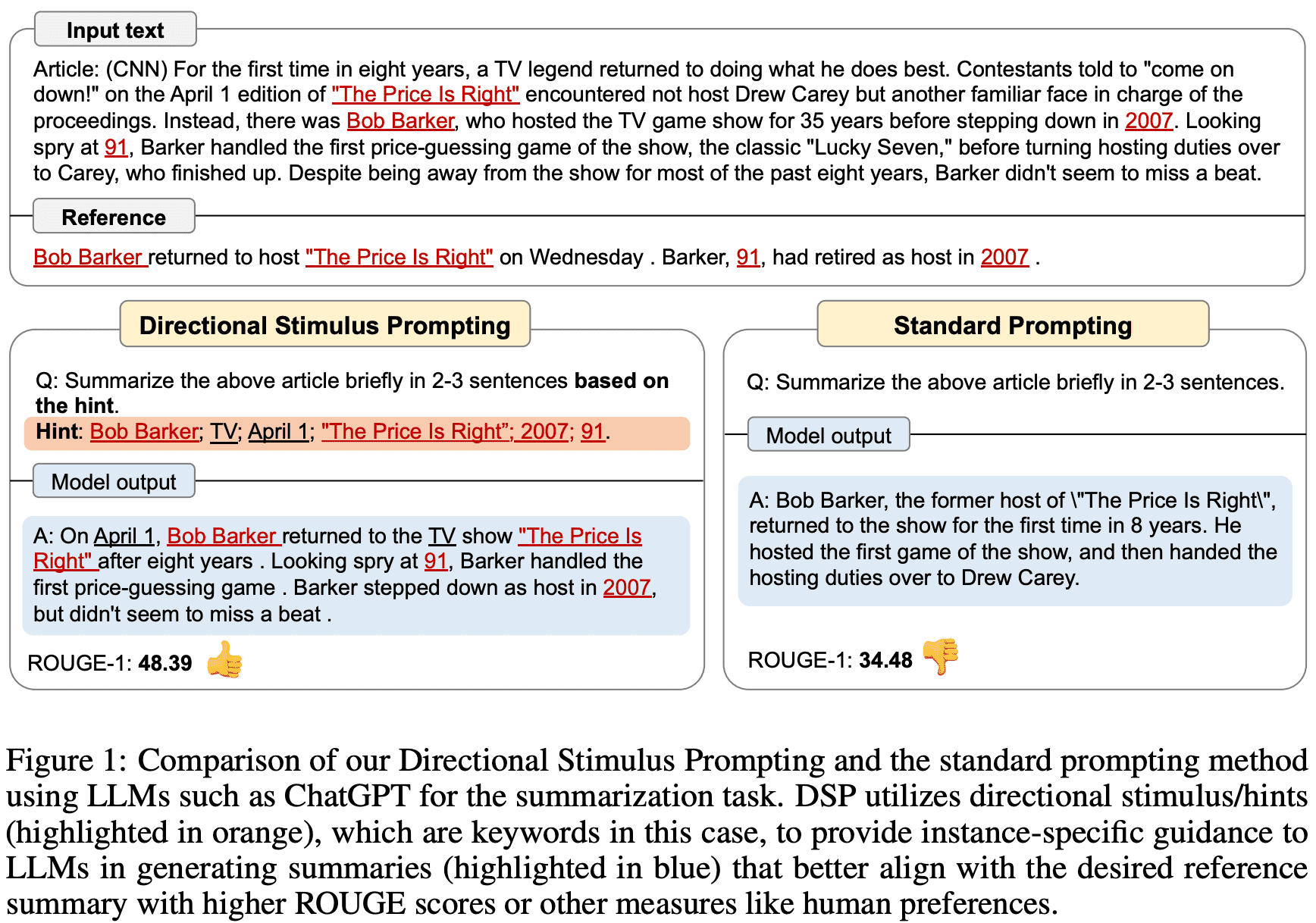

Directional Stimulus Prompting,用于引导黑盒大语言模型(LLM)生成指定的目标输出。不直接修改 / 微调大模型,而是使用一个小型可训练的策略模型(如 T5),为每一个输入样本生成一条辅助性的方向刺激提示词。这些方向刺激提示词会作为精细、针对当前样本的提示 / 线索,引导大模型生成符合要求的结果,例如让摘要中包含指定关键词。这样避开了直接微调大模型的困难,而是通过优化小策略模型,生成能引导大模型行为的提示词。

策略模型的优化方式有两种:

- 有监督微调:使用标注数据训练

- 强化学习:基于大模型的输出结果(离线 / 在线奖励)

简单来说就是:不用训练大模型,只用一个小模型,自动给大模型生成 “精准引导词”,让大模型听话、输出更准、更符合要求。

- 普通提示:直接发「帮我总结这段话」,模型自由发挥,容易漏重点、跑偏;

- Directional Stimulus Prompting 提示:先用小模型自动算出必须包含的核心关键词 / 隐藏线索,塞进去当引导;

- 结果:模型摘要精准对标参考答案,评分(ROUGE)、人看的满意度都更高。